本地环境

Ubuntu 20.04.6 LTS (GNU/Linux 5.15.0-136-generic x86_64)

部署步骤

1.安装依赖项

sudo apt install -y curl docker.io2.安装Ollama

- 注意:Ollama 至少需要8G运行内存

curl -fsSL https://ollama.com/install.sh | sh将当前用户加入 docker 组(避免每次用 sudo)

sudo usermod -aG docker $USER

newgrp docker

# 刷新用户组(需要重新登录才会永久生效)2.1 修改服务文件

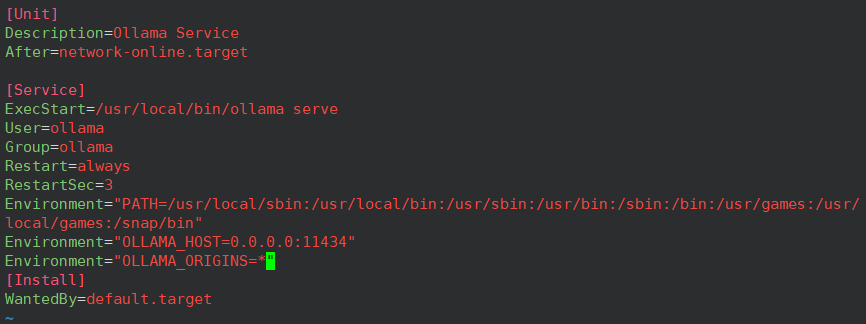

vim /etc/systemd/system/ollama.service修改并加入以下内容:

Environment="OLLAMA_HOST=0.0.0.0:11434"

Environment="OLLAMA_ORIGINS=*"

Environment="OLLAMA_HOST=0.0.0.0:11434"表示通过本地的11434端口访问。Environment="OLLAMA_ORIGINS=*"表示允许来自任何源的请求。

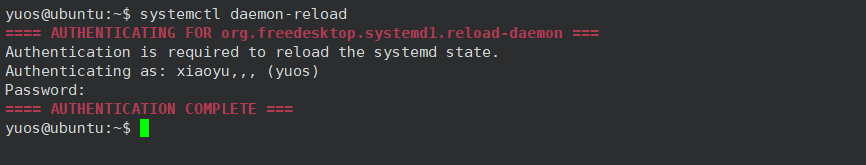

然后重启服务:

sudo systemctl daemon-reload

sudo systemctl restart ollama

# 重载配置文件并启动服务

sudo ufw allow 11434/tcp

sudo ufw reload

# 放行端口并重载配置

sudo systemctl start ollama

sudo systemctl enable ollama

# 启动 Ollama 服务并设置开启自启

3.验证安装

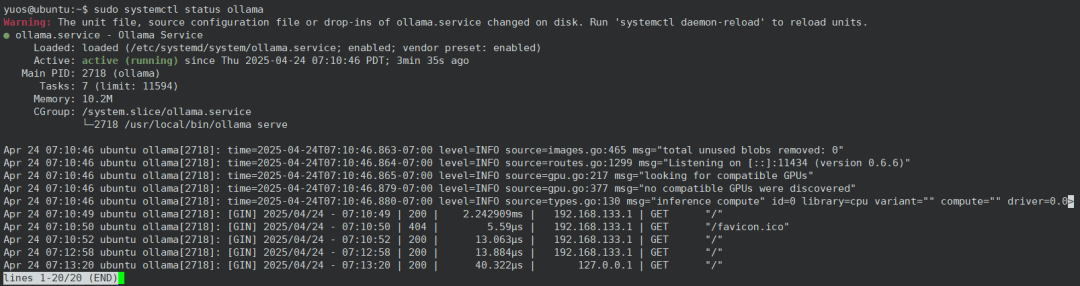

3.1检查服务状态

sudo systemctl status ollama

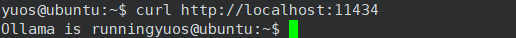

3.2 测试 API 访问

curl http://localhost:11434输出应当是:

3.3检查服务端口

sudo lsof -i :11434 3.4 查看详细日志(如果有报错)

sudo journalctl -u ollama -xe --no-pager4.检查docker

4.1 检查 Docker 状态

sudo systemctl status docker4.2 启动 Docker

sudo systemctl start docker

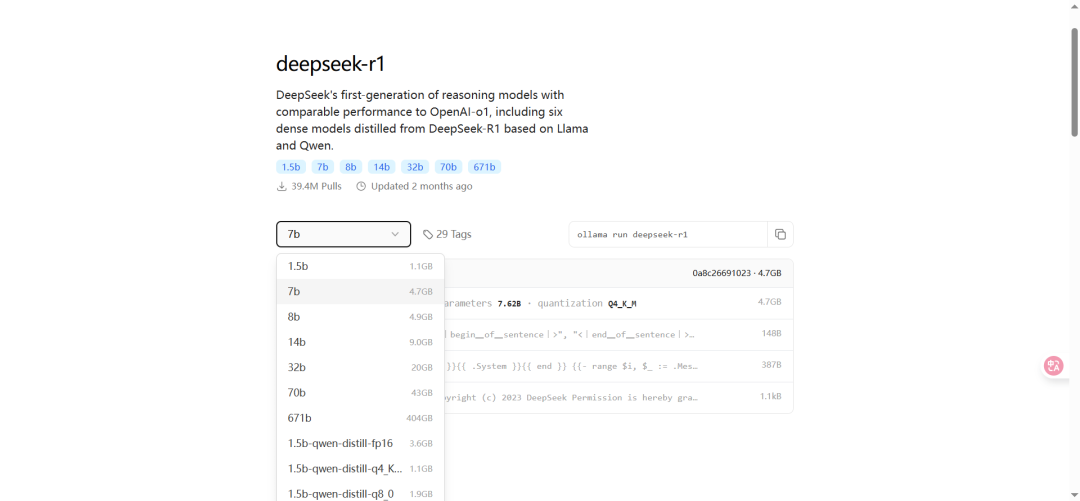

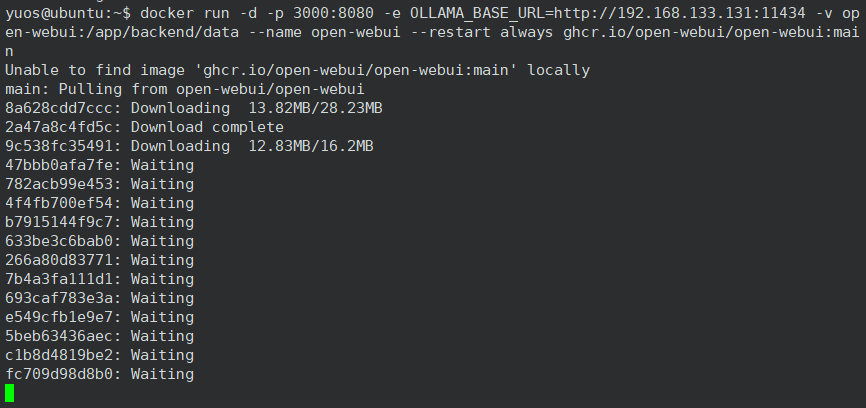

sudo systemctl enable docker5.部署Deepseek R1模型

网址:https://ollama.com/library/deepseek-r1

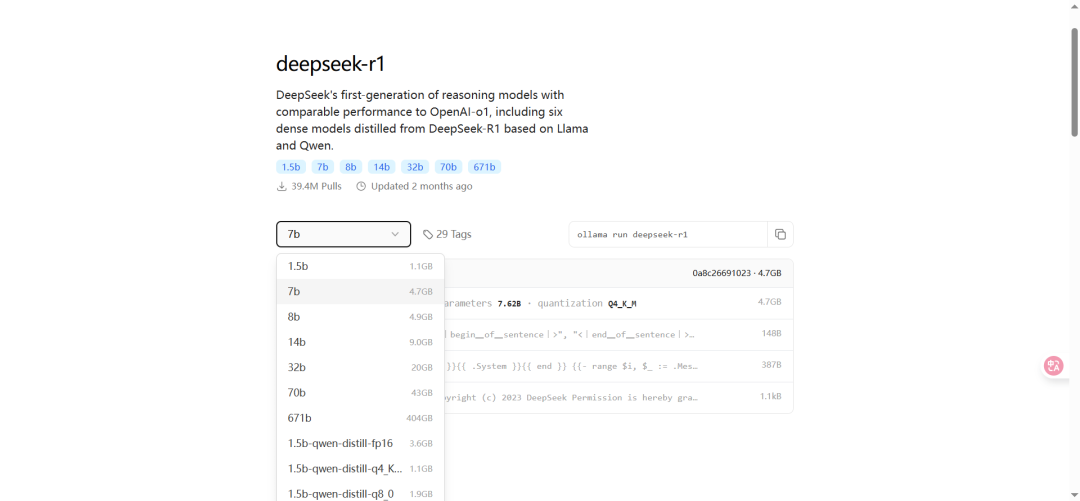

ollama run deepseek-r1:1.5b

# 部署完成后,重新进入会话也是这个命令

部署完成后会进入会话页面

Ctrl + d or /bye to exit. 即Ctrl + d 或者 /bye 进行退出

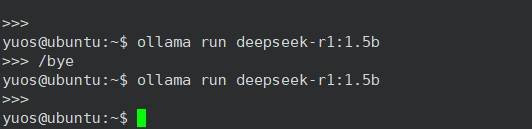

5.1 配置可视化界面

docker run -d -p 3000:8080 \

-v open-webui:/app/backend/data \

--name open-webui \

--restart always \

-e OLLAMA_API_BASE_URL=http://host.docker.internal:11434 \

ghcr.io/open-webui/open-webui:main

# 标准命令docker run -d -p 3000:8080 -e OLLAMA_BASE_URL=http://192.168.133.131:11434 -v open-webui:/app/backend/data --name open-webui --restart always ghcr.io/open-webui/open-webui:main

# 本机实际命令

# URL = 需要改为你的实际ip地址,不知道就用 ip addr 查

sudo ufw allow 3000/tcp

sudo ufw reload

# 如果3000端口未开,则防火墙放行下

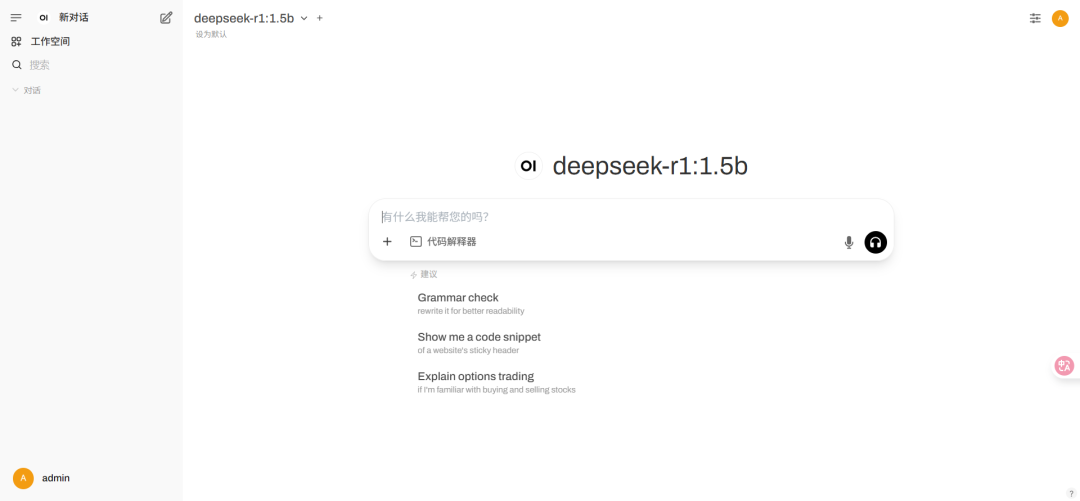

5.2 配置网页界面

http://192.168.133.131:3000/

# 并设置管理员

需要修改的配置:

1.管理员面板 -> 设置 -> 通用 -> 允许新用户注册(打开)

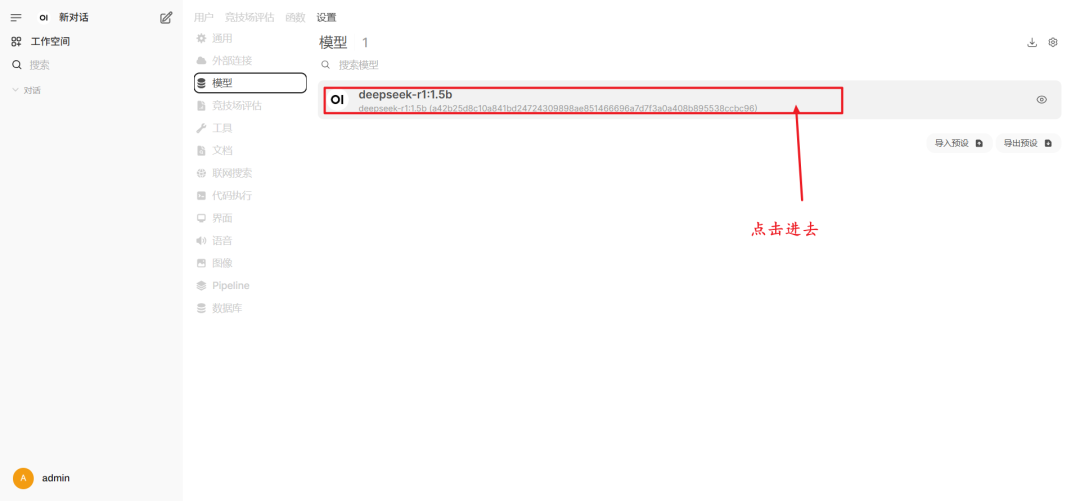

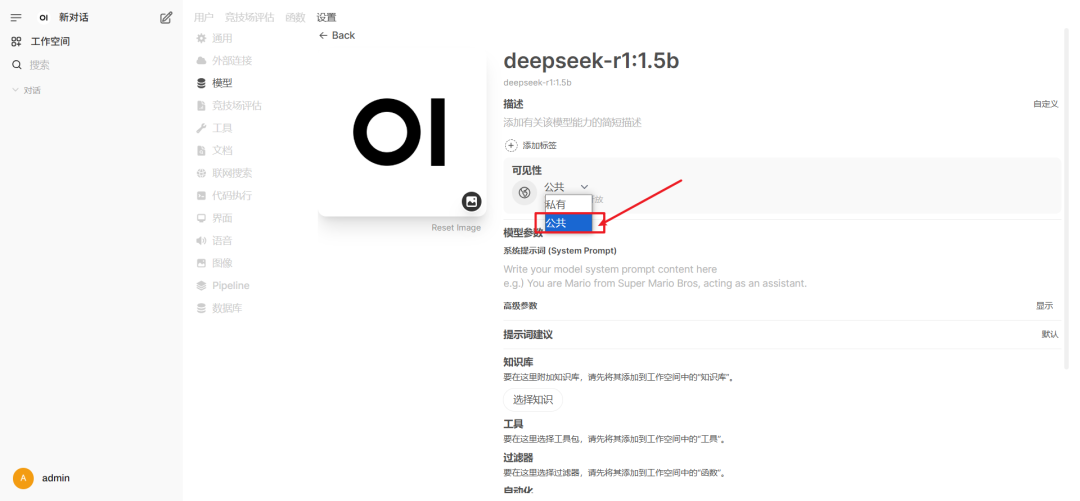

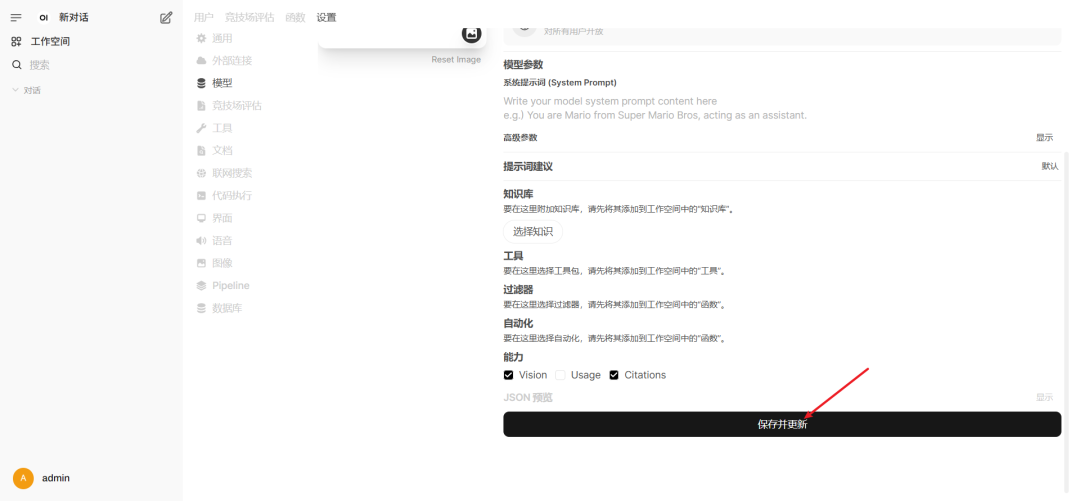

2.管理员面板 -> 设置 -> 模型 -> 可见性 -> Public

6.监控GPU (可选)

开源项目:https://github.com/XuehaiPan/nvitop

sudo apt install -y python3.8-venv

# 安装python 环境

sudo apt install -y pipx

# 安装pip库

sudo add-apt-repository ppa:graphics-drivers/ppa

# 添加英伟达库

sudo apt update

# 更新库

nvidia-smi

# 检查英伟达驱动

sudo apt install nvidia-driver-525

# 如果你的显卡是 NVIDIA T4 Tensor Core GPU 你可以安装 nvidia-driver-525 或更高版本的驱动,因为 T4 显卡支持这些驱动版本

sudo apt install nvidia-driver

# 如果你希望安装最新的稳定版本,可以使用 nvidia-driver 来自动选择适合你系统的版本

sudo reboot

# 安装完驱动后,重启系统以加载新的驱动重启后,再次尝试运行 nvidia-smi,检查驱动是否已正确安装:

nvidia-smi

# 如果一切正常,应该能够看到 NVIDIA T4 的信息和状态。

pipx run nvitop

#你就可以继续使用 nvitop 和其他依赖 NVIDIA 驱动的工具了,例如 安装nvitop 监测工具。7.最终效果

双显卡ollama负载均衡配置文件:

[Unit]

Description=Ollama Service

After=network-online.target

[Service]

User=ollama

Group=ollama

Environment="OLLAMA_LIBRARY_PATH=/usr/local/lib/ollama"

Environment="PATH=/usr/local/cuda/bin:$PATH"

Environment="LD_LIBRARY_PATH=/usr/local/cuda/lib64:$LD_LIBRARY_PATH"

ExecStart=/usr/local/bin/ollama serve

Restart=always

RestartSec=3

#WorkingDirectory=/usr/share/ollama # 添加工作目录

Environment="PATH=/usr/local/sbin:/usr/local/bin:/usr/sbin:/usr/bin:/sbin:/bin:/usr/games:/usr/local/games:/snap/bin:/snap/bin"

Environment="OLLAMA_HOST=0.0.0.0:11434"

Environment="CUDA_VISIBLE_DEVICES=0,1"

Environment="OLLAMA_SCHED_SPREAD=1"

Environment="OLLAMA_KEEP_ALIVE=1"

Environment="OLLAMA_PORT=11434"

[Install]

WantedBy=default.target